Erklärbare KI für personalisierte Behandlung: Eine neue Ära der vertrauenswürdigen Gesundheitsversorgung

Was wäre, wenn Ihr Arzt Ihnen einen vom KI generierten Behandlungsplan übergeben würde, ohne zu erklären, warum? Würden Sie ihm vertrauen?

In der heutigen datengestützten Gesundheitslandschaft wächst die KI in der Diagnose von Krankheiten und der Anleitung personalisierter Behandlungen. Aber ohne Transparenz kann selbst die genaueste KI Zweifel hervorrufen.

Erklärbare KI (XAI) bietet klare, für Menschen lesbare Einblicke, wie Entscheidungen getroffen werden. Sie verwandelt KI von einer Blackbox in ein Werkzeug, dem Kliniker und Patienten vertrauen können.

Lassen Sie uns erkunden, wie XAI die personalisierte Medizin umgestaltet, warum das wichtig ist und welche Herausforderungen es gibt.

Verständnis von erklärbarer KI (XAI)

Erklärbare KI (XAI) bezieht sich auf künstliche Intelligenzsysteme, die darauf ausgelegt sind, ihre Entscheidungsfindungsprozesse für Menschen transparent und verständlich zu machen. Im Gegensatz zu traditionellen „Blackbox“-Modellen, die Ausgaben bereitstellen, ohne ihre Logik zu offenbaren, macht XAI klar, wie Eingaben Ergebnisse beeinflussen.

Diese Klarheit ist im Gesundheitswesen entscheidend. Wenn ein KI-System eine Diagnose oder Behandlung vorschlägt, müssen Ärzte und Patienten verstehen, warum. Tools wie SHAP (Shapley Additive Explanations), LIME (Local Interpretable Model-agnostic Explanations) und Grad-CAM sind hier hilfreich.

Diese Methoden zeigen auf, welche Merkmale, Datenpunkte oder Bildbereiche zur Entscheidung der KI beigetragen haben, wodurch der Prozess für die klinische Nutzung interpretierbar wird.

Durch die Bereitstellung von Erklärungen in visuellen, textlichen oder numerischen Formen verwandelt XAI komplexe KI-Ausgaben in umsetzbare Erkenntnisse. Diese Transparenz hilft, KI-Tools mit medizinischem Denken und menschlicher Intuition in Einklang zu bringen, beides ist im Patientenservice entscheidend.

Warum das Gesundheitswesen Erklärbarkeit verlangt

Erklärbarkeit spielt eine entscheidende Rolle beim Aufbau von Vertrauen. Studien zeigen, dass undurchsichtige KI-Modelle die Therapietreue verringern und die Zusammenarbeit zwischen Patient und Anbieter schwächen. Wenn KI-Systeme keine Begründungen für ihre Ausgaben liefern, haben Kliniker Schwierigkeiten, die Empfehlungen für Patienten zu validieren oder zu verteidigen.

Personalisierte Behandlung erfordert die Anpassung der Versorgung an die individuelle Geschichte, Biologie und Präferenzen. Ohne zu verstehen, wie ein KI-System diese Faktoren bewertet, wird Personalisierung bedeutungslos.

Erklärbarkeit hilft, rechtliche und ethische Standards zu erfüllen, wie z.B. die DSGVO der EU, die das Recht der Individuen betont, automatisierte Entscheidungen zu verstehen. Für Gesundheitsanbieter bedeutet dies, KI-Tools auszuwählen, die ihre Begründungen erklären.

Zusammenfassend verlangt das Gesundheitswesen erklärbare KI, weil:

- Die Sicherheit der Patienten erfordert Klarheit, keine Annahmen.

- Klinisches Vertrauen beruht auf Verständnis, nicht auf Automatisierung.

- Rechtliche Standards verlangen Transparenz und Verantwortlichkeit.

Warum personalisierte Behandlung XAI benötigt

XAI gibt Kontext zu KI-Entscheidungen. Erklärbare KI stellt sicher, dass Personalisierung nicht einfach still im Hintergrund geschieht – sie geschieht offen, mit Klarheit und Ziel.

Wenn ein System ein bestimmtes Chemotherapie-Medikament über ein anderes empfiehlt oder die Insulindosierung für einen Diabetiker anpasst, können XAI-Tools zeigen, welche Faktoren zu dieser Wahl geführt haben.

Diese Erklärungen helfen Ärzten, die Empfehlung klarer gegenüber dem Patienten zu kommunizieren. Patienten müssen die Abwägungen langfristiger Behandlungen in der Dauerpflege und Onkologie verstehen.

Vertrauen, Adhärenz und gemeinsame Entscheidungen

Vertrauen ist die Grundlage der personalisierten Medizin. Patienten, die nicht verstehen, warum eine Behandlung speziell für sie gewählt wird, sind eher geneigt, diese in Frage zu stellen oder ganz zu vermeiden. Hier kommt XAI ins Spiel.

Studien zeigen, dass Patienten, wenn ihnen transparente, nachvollziehbare Begründungen für medizinische Entscheidungen, insbesondere solche die von KI generiert wurden, eher bereit sind, diesen Behandlungen zu folgen.

Im Gegensatz dazu führen vage oder undurchsichtige Empfehlungen zu Zweifeln, reduzierter Compliance und sogar Behandlungsabbrüchen.

XAI verbessert die gemeinsame Entscheidungsfindung, indem es Kliniker und Patienten ermöglicht, die Gründe hinter den KI-Empfehlungen zu verstehen. Es fördert den Dialog, ermutigt Patienten, bessere Fragen zu stellen, und ermöglicht Ärzten, evidenzbasierte Antworten basierend auf der Logik des Modells zu geben.

Diese Zusammenarbeit sorgt dafür, dass die Versorgung persönlichere Züge annimmt. Mit XAI erklärt, kollaboriert und unterstützt die KI Entscheidungen, die von Menschen getroffen werden.

Anpassung an den Einzelnen in Echtzeit

Personalisierte Pflege ist ein fortlaufender Prozess, der sich anpasst, während Patienten auf Behandlungen reagieren, Nebenwirkungen erfahren oder neue Symptome entwickeln. Interaktive XAI-Systeme ermöglichen es den KI-Modellen, aus neuen Daten zu lernen und aktualisierte Erklärungen für ihre Empfehlungen bereitzustellen.

Kliniker verwenden dynamische Tools anstelle von statischen Berichten, die es ihnen ermöglichen, Veränderungen im Laufe der Zeit zu verstehen. Wenn ein tragbares Gerät beispielsweise unregelmäßigen Schlaf oder steigenden Blutdruck erkennt, kann XAI zeigen, wie diese Muster die Behandlungsvorhersagen beeinflussen, was frühe Interventionen und Anpassungen der Versorgung unterstützt.

Kernkomponenten von XAI im Bereich der personalisierten Gesundheitsversorgung

Die Kernkomponenten von XAI kommen zusammen, um KI zu einem aktiven, transparenten und vertrauenswürdigen Partner bei der Bereitstellung wirklich personalisierter Versorgung zu machen.

Interpretierbare Algorithmen für Entscheidungen im echten Leben

Im Mittelpunkt von XAI steht, KI verständlich zu machen und gleichzeitig die Genauigkeit zu wahren. In der personalisierten Gesundheitsversorgung beginnt dies mit der Auswahl eines Algorithmus.

Interpretierbare Modelle, wie Entscheidungsbäume, zeigen klar, wie Variablen Entscheidungen beeinflussen. Im Gegensatz dazu können auch komplexe Modelle, wie Deep Learning, durch XAI-Techniken erklärt werden.

Für personalisierte Medikationspläne zeigen interpretierbare Modelle, wie Gewicht und Nierenfunktion die Dosierungsempfehlungen beeinflussen, wodurch das Vertrauen der Ärzte in die KI-Vorschläge erhöht wird und sie Behandlungen effektiv anpassen können.

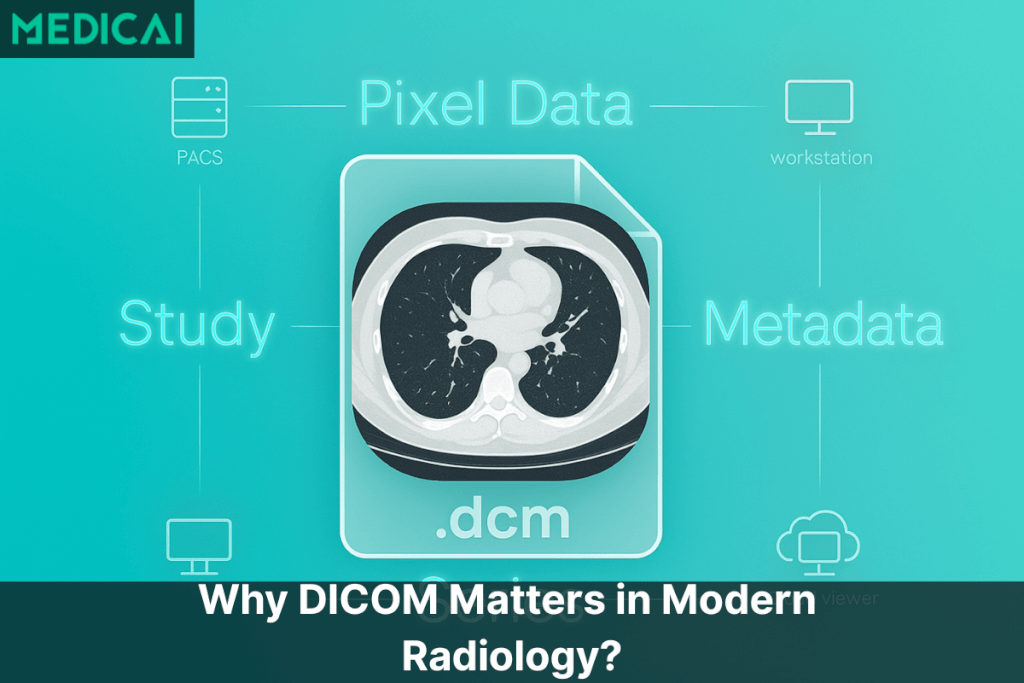

Visuelle und interaktive Erklärungen

Visuelle Erklärungsmethoden wie Grad-CAM und Saliency Maps sind entscheidend in der medizinischen Bildgebung. Sie heben Bereiche in MRI- oder CT-Scans hervor, auf die sich die KI bei Diagnosen konzentriert. Diese Werkzeuge helfen Radiologen und unterstützen Patienten beim visuellen Verständnis der Befunde.

Interaktive Dashboards verbessern die Benutzererfahrung, indem sie es Kliniker und Patienten ermöglichen, Eingaben anzupassen und sich ändernde Empfehlungen zu sehen, was gemeinsame Diskussionen und aktives Engagement fördert.

Medicai integriert visuelle Erklärungen wie Grad-CAM direkt in seinen Bildbetrachter, damit Kliniker sowohl das Ergebnis als auch die Begründung in einem nahtlosen Workflow bewerten können.

Lernen durch Feedback und Echtzeitanpassung

Die Stärke moderner XAI liegt in ihrer Fähigkeit, kontinuierlich aus realen Interaktionen zu lernen. Interaktive erklärbare Systeme können über statische Vorhersagen hinauswachsen.

Wenn Kliniker Feedback geben oder sich die Bedingungen der Patienten ändern, können diese Modelle ihre Ausgaben anpassen und erklären, warum diese Änderungen vorgenommen wurden. Es schafft einen adaptiven KI-Assistenten, der die Genauigkeit kontinuierlich verbessert und interpretierbar bleibt.

Techniken und Werkzeuge in der erklärbaren KI

Mehrere wichtige Werkzeuge erleichtern die Funktionsweise erklärbarer KI im Gesundheitswesen.

Modellunabhängige Methoden: Vielseitigkeit über alle Bereiche

Modellunabhängige XAI-Techniken funktionieren mit jedem Machine-Learning-Modell, indem sie sich auf die Ausgabenanalyse anstatt auf interne Mechanismen konzentrieren. Dadurch sind sie flexibel und weitreichend in Gesundheitssystemen anwendbar.

Zwei der am häufigsten verwendeten Techniken in dieser Kategorie sind:

- SHAP (SHapley Additive Explanations): SHAP, aus der kooperativen Spieltheorie, weist den Merkmalen in Vorhersagen Beitragswerte zu. Es hilft zu erklären, warum ein Patient mit spezifischen Biomarkern besser für Medikament A als für Medikament B geeignet ist.

- LIME (Local Interpretable Model-agnostic Explanations): LIME vereinfacht ein Modell um eine spezifische Vorhersage, damit Kliniker die Schlüsselfunktionen identifizieren können, die diesen Fall beeinflussen.

Diese Werkzeuge befähigen Kliniker, Vorhersagen patientenweise zu interpretieren, was entscheidend ist, um Behandlungspläne in hochgradig individualisierten Versorgungssettings zu erklären.

Gegenfaktische Erklärungen: Erforschen der „Was-wäre-wenn“-Szenarien

Gegenfaktische Erklärungen sind ein mächtiger Weg, um alternative Ergebnisse zu erkunden. Sie beantworten Fragen wie: Was müsste sich im Profil eines Patienten ändern, damit die KI eine andere Behandlung empfiehlt?

Diese Art des Denkens ist für Ärzte intuitiv und hilfreich bei ethischen Überprüfungen. Sie ermöglicht es Anbietern, die Entscheidungsgrenze des KI-Modells zu verstehen und Grenzfälle zu betrachten, wie z.B. Patienten, die möglicherweise grenzwertige Risiken oder mehrdeutige Profile haben.

Durch die Bereitstellung dieser Art von „Szenarientests“ fügt das gegenfaktische Modell eine Schicht klinischer Stabilität hinzu und hilft Ärzten, alternative Interventionen zu durchdenken.

Modellspezifische Methoden: Tiefere Erklärungen für spezialisierte Modelle

Einige XAI-Werkzeuge sind darauf ausgelegt, mit bestimmten Modellen zu arbeiten, wie z.B. Deep-Learning-Systemen, die in der medizinischen Bildgebung, Pathologie oder Genomik verwendet werden.

Zum Beispiel,

- Grad-CAM (Gradient-weighted Class Activation Mapping): Es hebt Teile eines Bildes hervor, die die Entscheidung eines Modells beeinflusst haben. Es wird häufig in der Radiologie und Onkologie verwendet, um zu zeigen, wo das Modell fokussiert war, als es Tumore oder Läsionen identifiziert hat.

- Saliency Maps: Zeigen pixelgenaue Wichtigkeit in bildbasierten Modellen. Diese helfen Pathologen, Biopsie-Scans zu interpretieren und zu verstehen, wie die KI diagnostiziert hat.

- Merkmalsvisualisierung: Sie hilft bei der Interpretation tiefer neuronaler Netze in Nicht-Bilddomänen, indem sie die neuronalen oder Schichtreaktionen auf spezifische Muster anzeigt, nützlich für Genomik und prädiktive Diagnostik.

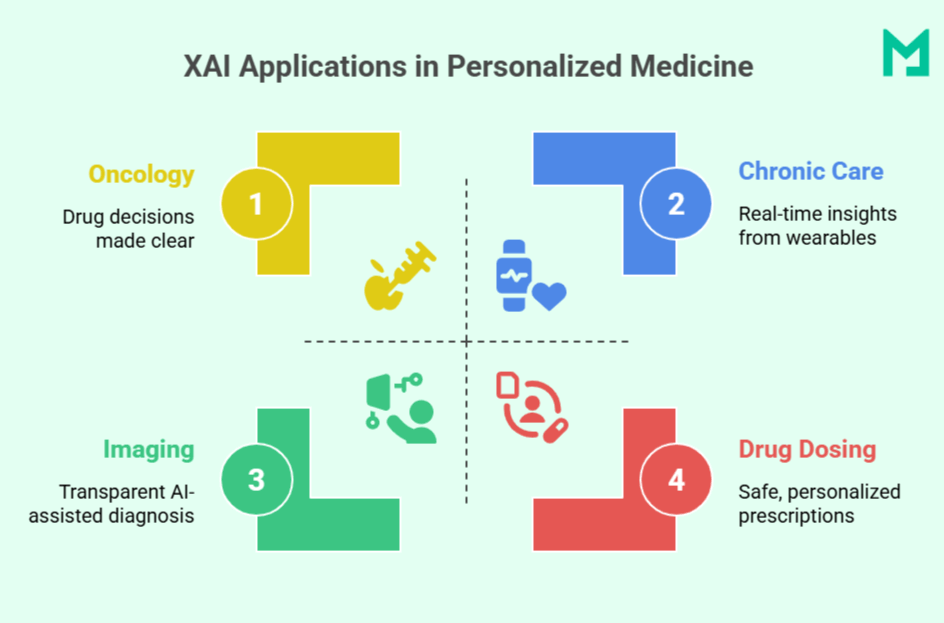

Spezifische Anwendungen von XAI in personalisierten Behandlungen

Indem XAI das „Warum“ hinter dem „Was“ klärt, bringt es die KI-gestützte Medizin näher an die alltägliche, patientenorientierte Versorgung.

Präzisionsonkologie

Die Entscheidungen zur Krebsbehandlung stützen sich zunehmend auf molekulare Profilierung, Tumorstadien und die Patientenhistorie. Erklärbare KI (XAI) macht deutlich, wie diese Faktoren die Auswahl der Therapie beeinflussen.

Beispielsweise verwendet IBM Watson for Oncology XAI, um komplexe Entscheidungen mit klaren Begründungen zu vereinfachen und genetische Mutationen sowie frühere Reaktionen mit Empfehlungen zu verknüpfen. Es hilft Onkologen, KI-Vorschläge mit klinischem Denken in Einklang zu bringen und das Vertrauen der Patienten in ihre Versorgung zu stärken.

Risikostratifizierung und chronisches Management von Krankheiten

In der chronischen Pflege (z.B. Diabetes, Hypertonie) ermöglicht XAI personalisierte Interventionen durch die Überwachung von Patientendaten aus tragbaren Geräten oder elektronischen Gesundheitsakten in Echtzeit. Erklärbarkeit ist entscheidend; Werkzeuge wie SHAP können zeigen, ob ein Glukoseanstieg auf Schlafmangel, Ernährung oder Stress zurückzuführen war.

Es ermöglicht Kliniker, die Behandlung mit Einblick in die Rationale des Modells anzupassen und die Sicherheit und Reaktionsfähigkeit zu verbessern.

Diagnostische Bildgebung und Pathologie

Deep Learning wird häufig in der medizinischen Bildgebung verwendet, aber seine Komplexität kann das klinische Vertrauen untergraben.

XAI hilft, indem sie visuelle Erklärungen bereitstellt, wie Grad-CAM und Saliency Maps, die Schlüsselbereiche in Scans oder Folien hervorheben, die die KI-Diagnosen beeinflusst haben, wie z.B. Lungenknoten oder maligne Zellen. Dies hilft Radiologen und Pathologen, Befunde zu verifizieren, sie Patienten zu erklären und potenzielle Modellfehler zu erkennen.

Klinische Entscheidungsunterstützungssysteme (CDSS)

XAI-unterstützte CDSS-Tools unterstützen Behandlungsentscheidungen in der Primärversorgung und in Krankenhäusern. Im Gegensatz zu herkömmlichen Warnungen bieten erklärbare Systeme wie MediAssist klare Begründungen, die aufzeigen, wie Symptome, Vitalwerte und Laborergebnisse auf eine Pneumonie und nicht auf Bronchitis hinweisen.

Diese Transparenz hilft Kliniker, schnellere, informierte Entscheidungen zu treffen und die diagnostische Genauigkeit zu verbessern, während gleichzeitig die Warnmüdigkeit reduziert wird.

Personalisierte Arzneimittelverabreichung und Pharmakogenomik

Die Medikamentenreaktion unterscheidet sich von Person zu Person.

XAI verbessert pharmakogenomische Modelle, um die Auswahl und Dosierung von Medikamenten zu personalisieren, indem genetische Marker, Alter und Leberfunktion berücksichtigt werden. Kliniker erhalten Dosierungsempfehlungen und Einblicke in deren Geeignetheit, was präzises Verschreiben sicherer und zuverlässiger macht.

Klinische Vorteile von XAI in der personalisierten Pflege

Erklärbare KI bietet mehr als nur genaue Vorhersagen.

| Stakeholder | Wesentliche Vorteile | Auswirkungen |

| Kliniker | Verstehen, welche Variablen KI-Entscheidungen antreibenValidieren und anpassen KI-VorschlägeUnsicherheit in der Diagnose reduzieren | Aufbau von diagnostischer ZuversichtFörderung schnellere, informierte EntscheidungenFörderung des Vertrauens der Kliniker |

| Patienten | Erhalten klare Erklärungen für BehandlungenVerstehen, wie persönliche Faktoren die Versorgung beeinflussenFühlen sich in Entscheidungen einbezogen | Steigerung des Vertrauens und der ZufriedenheitVerbesserung der TherapietreueUnterstützung gemeinsamer Entscheidungsfindung |

| Gesundheitssysteme | Sicherstellung von Transparenz in KI-ToolsErkennung und Bekämpfung von VorurteilenEinhaltung rechtlicher und ethischer Standards (z.B. DSGVO, FDA) | Ermöglicht die Einhaltung von VorschriftenVerbessert Sicherheit und FairnessStärkt die Verantwortlichkeit |

Der Ansatz von Medicai zur erklärbaren Bildgebung trägt dazu bei, die Kluft zwischen KI-Diagnosen und menschlicher Validierung zu schließen und das Vertrauen der Kliniker sowie die Patientenbindung zu verbessern.

Herausforderungen bei der Implementierung erklärbarer KI für personalisierte Behandlungen

Bei der Implementierung von XAI für personalisierte Behandlungen können einige Herausforderungen auftreten.

Das Gleichgewicht zwischen Genauigkeit und Interpretierbarkeit

Ein häufiges Dilemma in der XAI ist zwischen Modellkomplexität und Erklärbarkeit. Deep-Learning-Modelle erreichen eine hohe Genauigkeit mit komplexen medizinischen Daten, sind aber oft für Kliniker schwer zu verstehen.

Einfachere Modelle, wie Entscheidungsbäume, sind leichter zu interpretieren, könnten jedoch in nuancierten Fällen an prädiktivem Potenzial mangeln. Das Finden des richtigen Gleichgewichts bleibt herausfordernd, insbesondere wenn es um Leben und Tod geht.

Mangelnde Standardisierung

Es gibt keine universelle Definition eines „erklärbaren“ KI-Modells, was zu Variationen in Methoden, Formaten und Details in verschiedenen Tools führt. Diese Inkonsistenz erschwert die Vertrauensbewertung für Gesundheitsanbieter und stellt eine Herausforderung für die regulatorische Genehmigung dar, da Behörden jedes System einzeln bewerten müssen, ohne klare Benchmarks.

Integration in klinische Abläufe

Viele Gesundheitseinrichtungen verlassen sich auf veraltete Systeme und isolierte Datenbanken, was die Integration erklärbarer KI (XAI) herausfordernd macht.

Die benutzerdefinierte Integration mit elektronischen Gesundheitsakten (EHRs) kann die Implementierung verzögern, und Kliniker benötigen Zeit und Schulung, um sich an diese neuen Werkzeuge anzupassen und ihnen zu vertrauen. In Drucksituationen ist es oft schwierig.

Datenschutz und Sicherheit

XAI erfordert detaillierte Patientendaten für genaue Einblicke, was Datenschutzbedenken aufwirft. Die Einhaltung von HIPAA und anderen Gesetzen ist entscheidend, und Entwickler müssen sicherstellen, dass Erklärungen während Tests oder Bereitstellungen nicht unbeabsichtigt sensible Informationen offenbaren.

Fazit

Erklärbare KI redefiniert, was es bedeutet, wirklich personalisierte Pflege zu bieten, indem sie medizinische Entscheidungen transparent, vertrauenswürdig und patientenorientiert macht. In einer Welt, in der KI für Diagnose und Behandlung essenziell wird, führen Plattformen wie Medicai den Weg, indem sie sicherstellen, dass Kliniker nicht nur Antworten erhalten, sondern diese auch verstehen.

Mit der Entwicklung des Gesundheitswesens wird Erklärbarkeit nicht optional sein – sie wird erwartet.

Verwandte Artikel

Das Gespräch beginnen

Erfahren Sie mehr darüber, wie Medicai Ihnen helfen kann, Ihre Praxis zu stärken und die Patientenerfahrung zu verbessern. Sind Sie bereit, Ihre Reise zu beginnen?

Kostenlose Demo buchen