MRT-Bildsegmentierung von Gehirntumoren mit Deep-Learning-Techniken

Stellen Sie sich vor, Stunden manueller Segmentierung von Gehirn-MRTs auf Sekunden zu reduzieren.

Die Grenzen von Gehirntumoren entstehen automatisch, und Deep Learning macht dies möglich. Es bringt Präzision, Geschwindigkeit und Konsistenz in die Neuro-Onkologie-Workflows.

Deep Learning nutzt CNNs, Attention U-Nets und Transformer-Hybride zur automatischen Segmentierung multi-modal MRT-Scans. Diese Modelle übertreffen klassische Methoden in Bezug auf Geschwindigkeit, Genauigkeit und Reproduzierbarkeit und ermöglichen eine präzise Abgrenzung von Tumorrändern für den klinischen Einsatz in verschiedenen Umgebungen.

Entdecken Sie die Segmentierung von Gehirntumor-MRT-Bildern mit Deep Learning-Techniken: Kernarchitekturen, Datensätze und klinische Auswirkungen.

Was ist die MRT-basierte Segmentierung von Gehirntumoren?

Die MRT-basierte Segmentierung von Gehirntumoren unterteilt MRT-Scans in beschriftete Bereiche und trennt Tumorgewebe von gesunden Gehirnstrukturen. Jeder Voxel wird nach gemeinsamen Merkmalen gruppiert, einschließlich:

- Intensität

- Textur

- Grenzen

Sie erstellen eine klare Karte der Tumorunterregionen.

Diese automatisierte Gruppierung ersetzt das Raten durch präzise, datengestützte Beschriftungen. Die Segmentierung ist der entscheidende erste Schritt für jede nachfolgende Analyse.

Bei der manuellen Segmentierung zeichnen erfahrene Radiologen mühsam Tumourotlines auf jede Schicht des Bildes. Diese Schicht-für-Schicht-Tracierung kann Stunden pro Fall in Anspruch nehmen und variiert je nach Leser.

Automatisierte Deep Learning-Modelle lernen, diese Umrisse in Sekunden vorherzusagen. Halbautomatische Tools benötigen immer noch einige Benutzerkorrekturen; vollständig automatische Netzwerke liefern End-to-End-Vorhersagen ohne manuelle Eingabe.

Eine Umfrage hebt hervor, dass tiefe Netzwerke klassische Methoden sowohl in Bezug auf Geschwindigkeit als auch Konsistenz übertreffen.

Eine genaue Segmentierung trägt zu einer besseren Versorgung bei.

- Sie liefert präzise Volumenmessungen für die Strahlentherapieplanung.

- Sie standardisiert Regionen für die extrahierung radiomikaler Merkmale, wodurch zuverlässige Biomarker entstehen.

- Im Operationssaal leiten klare 3D-Tumorkarten Chirurgen dazu, die Resektion zu maximieren und gleichzeitig gesundes Gewebe zu erhalten.

Die automatisierte Segmentierung beschleunigt somit Workflows und untermauert die personalisierte Neuro-Onkologie.

Warum Deep Learning für die Segmentierung von Gehirntumor-MRT-Bildern?

Klassische Bildverarbeitungstechniken – wie Schwellenwertbestimmung und Region Growing – segmentieren Tumoren, indem sie Pixel mit ähnlichen Intensitäten oder räumlicher Nähe gruppieren. Sie haben Schwierigkeiten, wenn die Tumorgrenzen verschwommen sind oder wenn sich die Intensität mit gesundem Gewebe überlappt.

Solche Methoden erfordern oft eine manuelle Feinabstimmung der Schwellenwerte für jeden Patienten und versagen in Anwesenheit von MRT-Geräusch oder variierenden Scanner-Einstellungen.

Faltung neuronale Netzwerke (CNNs) überwinden diese Grenzen, indem sie Merkmalshierarchien direkt aus den Daten lernen. Frühe Schichten erfassen Kanten und Texturen; tiefere Schichten kodieren komplexe Tumorformen und Kontexte.

Dieses End-to-End-Lernen ersetzt handgefertigte Regeln durch optimierte Filter. CNNs passen sich an multi-modale Eingaben (T1, T1c, T2, FLAIR) an,indem sie automatisch Informationen über Sequenzen hinweg fusionieren, um reichere Darstellungen zu erzielen.

Die Auswirkungen sind klar.

- Tiefe Modelle segmentieren vollständige 3D-Volumina in Sekunden, verglichen mit den Minuten oder Stunden, die manuell erforderlich wären.

- Sie liefern konsistente Ergebnisse über Fälle und Standorte hinweg und steigern die Reproduzierbarkeit.

- Sie integrieren sich nahtlos in multimodale Pipelines und verarbeiten jede Kombination von MRT-Kontrasten, ohne dass benutzerdefinierte Anpassungen erforderlich sind.

Diese Geschwindigkeit und Zuverlässigkeit beschleunigen klinische Workflows, unterstützen starke radiomikale Analysen und ermöglichen fast in Echtzeit Führung im Operationssaal.

Deep Learning-Architekturen in der Segmentierung von Gehirntumor-MRTs

Deep Learning-Architekturen haben die MRT-Segmentierung transformiert, indem sie komplexe Merkmale direkt aus Daten lernen. Finden Sie die Schlüsselmodelle, die diesen Fortschritt vorantreiben.

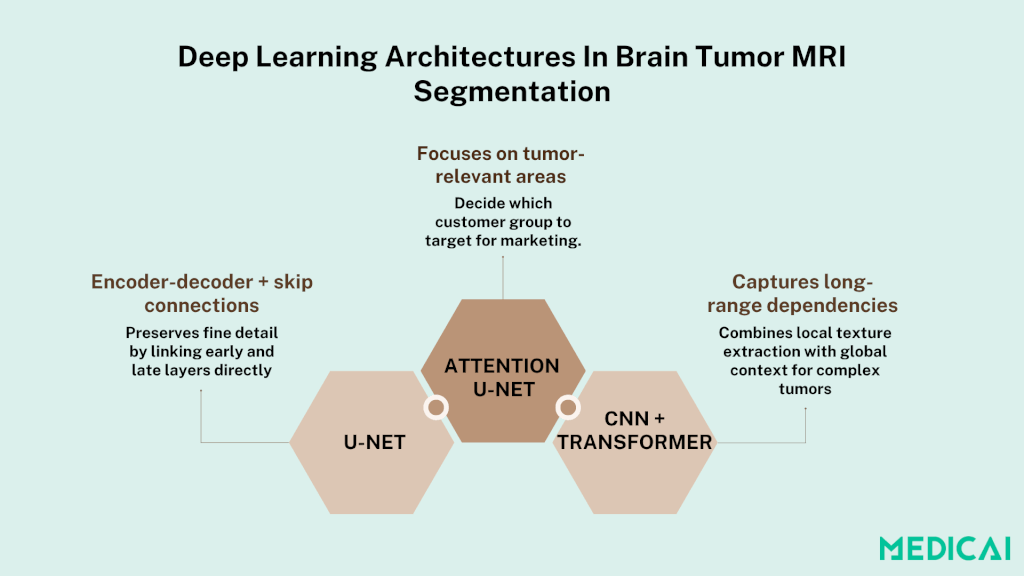

U-Net und seine Varianten

U-Net führte ein symmetrisches Encoder-Decoder-Design mit Skip-Verbindungen ein, die feingranulare Merkmale von Downsampling-Schichten direkt zu Upsampling-Schichten bringen. Dies ermöglicht es dem Netzwerk, räumliche Details, die während des Poolings verloren gehen, wiederherzustellen.

Frühe Schichten lernen Kanten und Texturen; tiefere Schichten erfassen den höheren Kontext.

3D U-Net erweitert dieses Konzept auf volumetrische Daten, indem es 2D-Faltungen durch 3D-Faltungen ersetzt.Es verarbeitet gesamte MRT-Volumina in einem Durchgang und erhält die interschichtliche Kontinuität und erhöht die Genauigkeit bei komplexen Tumorformen.

Dieser volumetrische Ansatz benötigt mehr Speicher, liefert jedoch kohärentere Segmentierungen über die Schnitte hinweg.

Attention U-Net

Augmentiert das U-Net-Rückgrat mit Attention-Gates, die Merkmalskarten basierend auf ihrer Relevanz für Tumorregionen neu gewichten. Räumliche Aufmerksamkeit hebt Schlüsselbereiche hervor, während Kanalaufmerksamkeit die informativsten Merkmalskanäle betont.

Dieser selektive Fokus ermöglicht es dem Modell, Hintergrundgeräusche zu ignorieren und sich an unregelmäßige Tumorgrenzen anzupassen. Studien haben gezeigt, dass AufmerksamkeitsmoduleDice-Werte, insbesondere für kleine oder diffuse Läsionen.

Transformatorbasierte Modelle

Bring Selbstaufmerksamkeit in die medizinische Bildgebung, indem sie Paarbeziehungen zwischen allen Voxel berechnen, um langfristige Abhängigkeiten und den globalen Kontext über lokale Faltungs rezeptive Felder hinaus zu erfassen.

Reine Transformatorenmodelle können datenhungrig sein, daher extrahieren hybride CNN-Transformator-Pipelines zuerst niedrigere Merkmale mittels Faltungen und verfeinern dann die Segmentierung mit Transformatorblöcken. Erste Ergebnisse zeigen, dass diese Hybride CNNs bei heterogenen Tumoren und in Bereichen mit spärlichen Daten übertreffen.

MRT-Segmentierung Deep Learning: Datensätze & Vorverarbeitung

Hochwertige Daten sind das Rückgrat jeder Deep-Learning-Pipeline. Eine ordnungsgemäße Vorverarbeitung verwandelt rohe Scans in zuverlässige Eingaben für robuste Modelle.

Öffentliche Benchmarks

Die Gehirntumor-Segmentierungs(Herausforderung (BraTS) bietet ein standardisiertes, multi-modales MRT-Datensatz– T1, kontrastverstärktes T1 (T1c), T2 und FLAIR – jeweils fachmännisch in Tumorunterregionen annotiert.

Forscher weltweit trainieren und evaluieren an BraTS, um faire Vergleiche zu gewährleisten und Innovationen voranzutreiben.

Vorverarbeitungsschritte

- Intensitätsnormalisierung – MRT-Scans variieren in Helligkeit und Kontrast, weshalb es notwendig ist, diese Unterschiede anzupassen. Techniken wie Z-Wert-Normalisierung oder Nyúl’s Methode passen die Intensitäten auf einen gemeinsamen Bereich an, um den Netzwerken zu helfen, konsistente Merkmale über Institutionen zu lernen.

- Schädelentfernung – Automatisierte Werkzeuge in der MRT entfernen Nicht-Gehirngewebe (Skalp, Schädel, Fett) und konzentrieren das Modell auf die Gehirnanatomie, wodurch falsch-positive Ergebnisse reduziert werden. Dieser Schritt verwendet Gehirnmasken, um relevante Voxel zu isolieren.

- Datenaugmentation – Zufällige Drehungen, Skalierungen, elastische Deformationen und Intensitätsverschiebungen erzeugen unterschiedliche Trainingsbeispiele im Fluss. Die Augmentation verhindert Überanpassung und verbessert die Generalisierung auf neue Tumorformen und Bildartefakte.

Patch-basiertes vs. Vollvolumetraining

Patch-basiertes Training extrahiert kleinere Teilvolumina (z. B. 80 × 80 × 80 Voxel) mit gleitenden Fenstern. Dies kommt dem GPU-Speicher entgegen, ermöglicht ein Überabtasten seltener Tumorregionen und balanciert die Klasseneinteilungen. Es kann jedoch den langfristigen Kontext verlieren.

Das Vollvolumetraining verarbeitet gesamte MRT-Scans in einem Durchgang (wie bei 3D U-Nets). Es erhält die räumliche Kontinuität und den globalen Kontext und führt zu kohärenteren Segmentierungen über die Schnitte hinweg. Der Kompromiss ist ein höherer Speicherbedarf und längere Trainingszeiten.

Zusammen bilden diese Benchmarks und Vorverarbeitungsschritte eine Grundlage für zuverlässige und reproduzierbare Gehirn-MRT-Segmentierung Modelle.

MRT-Segmentierung Deep Learning Evaluierungsmetriken

Mehrere Metriken erfassen verschiedene Facetten der Segmentierungsqualität und bieten sowohl Volumengenauigkeit als auch Grenzgenauigkeit.

Dice-Ähnlichkeitskoeffizient (DSC)

DSC misst die Überlappung zwischen der vorhergesagten Segmentierung und der tatsächlichen Wahrheit. Er liegt zwischen 0 (keine Überlappung) und 1 (perfekte Übereinstimmung). Ein höherer DSC zeigt eine bessere volumetrische Übereinstimmung, was ihn zu einem primären Benchmark für Tumorsegmentierungsaufgaben macht.

Hausdorff-Abstand

Die Metrik erfasst die bedeutendste Grenzabweichung zwischen der vorhergesagten und der tatsächlichen Tumorkontur. Sie gibt den maximalen Abstand an, den ein Punkt auf der vorhergesagten Grenze vom nächsten Punkt auf der tatsächlichen Grenze hat.

Niedrigere Werte zeigen eine engere Grenzausrichtung an, was für eine genaue chirurgische Planung entscheidend ist.

Sensitivität & Spezifität

Sensitivität (wahre positive Rate) misst, wie gut das Modell Tumorvoxel erkennt. Spezifität (wahre negative Rate) misst, wie genau es gesundes Gewebe ausschließt. Eine Balance zwischen beiden verhindert, dass Modelle eine Klasse bevorzugen, wodurch sichergestellt wird, dass weder Unter- noch Übersegmentierung dominiert.

Warum mehrere Metriken wichtig sind?

Keine einzelne Metrik erfasst alle Aspekte der Segmentierungsqualität.

- DSC glänzt bei der Volumenüberlappung, kann jedoch Grenzfehler verbergen.

- Hausdorff-Abstand zeigt Kantenunterschiede auf, ignoriert jedoch die Volumenüberlappung.

- Sensitivität und Spezifität heben Klassenbalanceprobleme hervor.

Die Verwendung aller vier stellt sicher, dass Modelle in klinischen Umgebungen verlässlich arbeiten und sowohl eine genaue Volumenschätzung als auch eine präzise Grenzabgrenzung unterstützen.

Herausforderungen & Lösungen

Hohe Variabilität bei MRT-Scannern und Protokollen kann Modelle verwirren, wenn sie nicht angegangen wird. Lassen Sie uns vier zentrale Herausforderungen und ihre Lösungen aufschlüsseln.

Scanner- & Protokollvariabilität

MRT-Daten stammen von verschiedenen Maschinen, Feldstärken und Bildgebungseinstellungen. Diese Variationen verschieben Intensitätsverteilungen und Rauschprofile, was dazu führt, dass Modelle, die an einem Zentrum trainiert wurden, in einem anderen versagen.

Techniken zur Anpassung von Domänen stimmen Merkmalsräume über verschiedene Standorte hinweg ab. Harmonisierung Netzwerke lernen explizit, Scans aus unterschiedlichen Protokollen in eine gemeinsame Darstellung zu kartieren, wodurch „Scannerbias“ verringert und die Leistung über Standorte hinweg verbessert wird.

Tumorklassenungleichheit

Tumorgewebe nimmt oft nur einen winzigen Bruchteil des Gehirnvolumens ein, wodurch positive Beispiele rar werden. Standardverluste (wie Kreuzentropie) führen dann dazu, dass Modelle dazu neigen, gesundes Gewebe vorherzusagen.

Spezialisiertes Verlustfunktionen wie Focal Loss werten einfache Negative herab und konzentrieren das Training auf Tumorvoxel. Grenzbewusste Verluste fügen Strafen hinzu für falsch platzierte Tumorkanten, was die Konturgenauigkeit bei kleinen oder diffusen Läsionen verbessert.

Rechenanforderungen

Volumetrische Modelle – insbesondere 3D U-Nets – benötigen großen GPU-Speicher und lange Trainingszeiten. Dies schränkt die Batchgrößen ein und verlangsamt das Experimentieren.

Effiziente Architekturen reduzieren die Parametervariationen. Mixed-Precision-Training verwendet niedrigere Rechnungen, wo es sicher ist, halbiert den Speicherbedarf und verdoppelt den Durchsatz, ohne die Genauigkeit zu beeinträchtigen.

Generalisierung & Robustheit

Modelle können auf die spezifischen Trainingsorte überanpassen, sodass sie bei unbekannten Daten versagen.

Eine rigorose Kreuzvalidierung nach Patient und Zentrum testet die Leistung in der realen Welt. Multi-institutionelles Training, sei es durch Pooling von Daten oder föderiertes Lernen, schafft robuste Modelle. Umfangreiche externe Tests gewährleisten die Zuverlässigkeit vor klinischen Einsätzen.

Klinische Anwendungen & Auswirkungen

Die Segmentierung bildet die Grundlage für wichtige klinische Aufgaben in der Neuro-Onkologie. Sie verwandelt rohe MRT-Scans in umsetzbare Einblicke für personalisierte Versorgung.

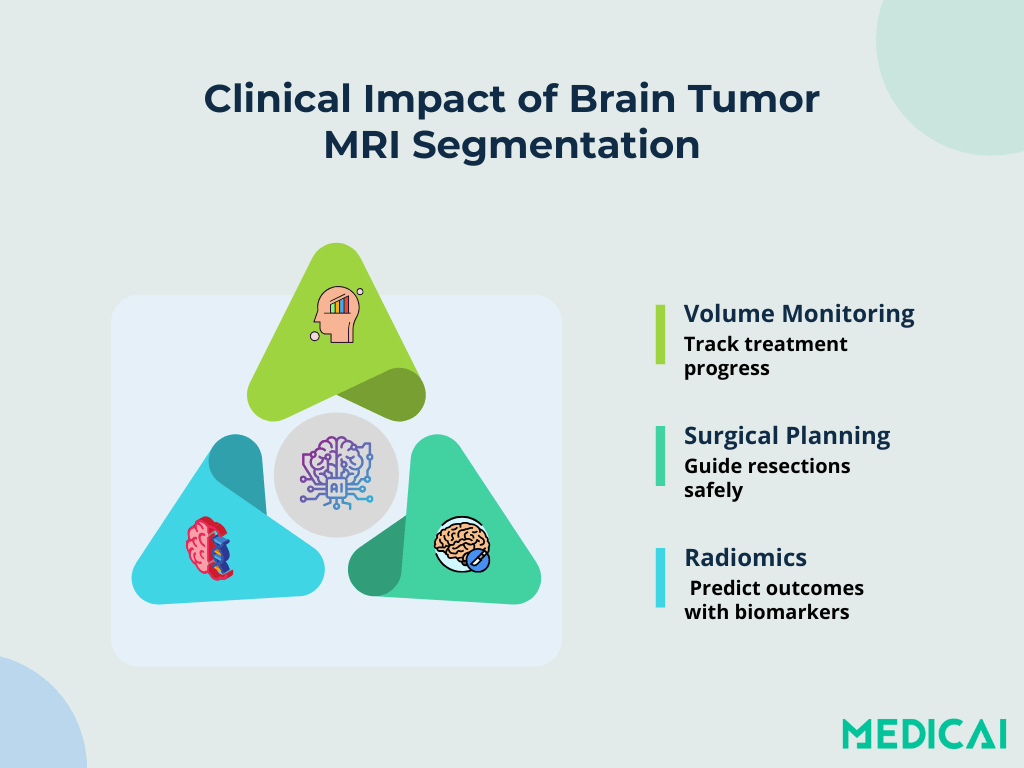

Volumetrisches Wachstum Monitoring

Automatisierte Modelle quantifizieren Tumorvolumen über Follow-up-Scans in Minuten. Die Verfolgung volumetrischer Veränderungen ermöglicht es Onkologen, die Therapieresponse zu bewerten und Therapiepläne anzupassen. Präzise Volumenmessungen verringern die Abhängigkeit von subjektiven Schätzungen und verbessern longitudinales Arbeiten.

Schwellenwertbestimmung für chirurgische Margen

Eine klare Abgrenzung von Tumorgrenzen leitet Neurochirurgen bei der Planung der Resektionsmargen. Dreidimensionale Karten, die aus der Segmentierung erstellt werden, helfen dabei, die maximale Tumorentfernung mit dem Erhalt gesunden Gewebes auszubalancieren.

Dies reduziert postoperative Defizite und unterstützt bessere funktionale Ergebnisse.

Radiomikale Merkmalsgewinnung

Sobald Tumorregionen definiert sind, extrahieren radiomikale Pipelines quantitative Merkmale – Textur, Form, Intensität – die als Bild-Biomarker dienen. Diese Metriken korrelieren mit molekularen Subtypen, sagen das Überleben der Patienten voraus und ermöglichen die Risikostratifizierung.

Konsistente, automatisierte Beschriftungen stellen sicher, dass radiomikale Analysen über Kohorten hinweg reproduzierbar bleiben.

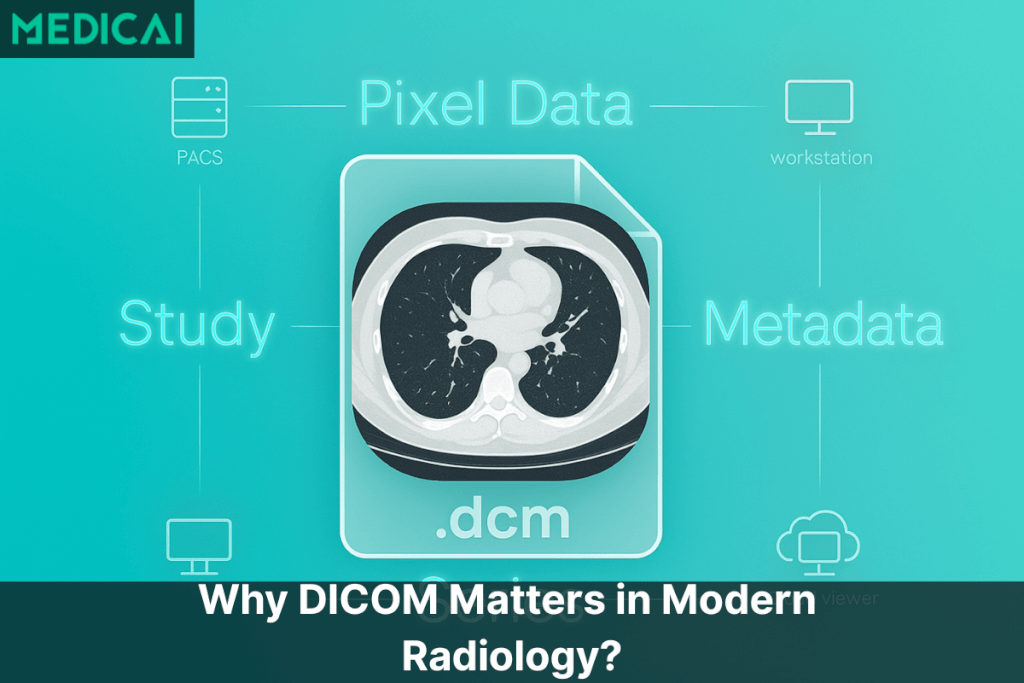

Integration in PACS & Behandlungsworkflows

Deep-Learning-Ausgaben speisen sich nahtlos in Bildarchivierungs- und Kommunikationssysteme (PACS), die von Plattformen wie Medicai bereitgestellt werden. Segmentierte Bilder erscheinen zusammen mit Rohscans in Radiologiearbeitsplätzen, sodass Kliniker Konturen überprüfen, anpassen und genehmigen können, ohne die Plattform zu wechseln.

Diese Integration beschleunigt das Reporting, unterstützt multidisziplinäre Tumorboards und optimiert den Weg von der MRT-Bildgebung zur Intervention.

Fazit

Deep Learning hat die Segmentierung von Gehirntumoren neu gestaltet. Moderne Modelle liefern schnelle und präzise Karten von Tumorgrenzen. Sie reduzieren Stunden manueller Arbeit auf Sekunden. Automatisierte Pipelines unterstützen die Therapieplanung, die Entdeckung radiomikaler Biomarker und die chirurgische Anleitung.

Die Plattform von Medicai bringt diese Werkzeuge direkt in Ihren Workflow. Sie integriert sich in Ihr PACS-Setup und liefert konsistente Ergebnisse über Fälle hinweg.

Verwandte Artikel

Das Gespräch beginnen

Erfahren Sie mehr darüber, wie Medicai Ihnen helfen kann, Ihre Praxis zu stärken und die Patientenerfahrung zu verbessern. Sind Sie bereit, Ihre Reise zu beginnen?

Kostenlose Demo buchen